生成AIのコアになっているのはTransformer(トランスフォーマー)と呼ばれる学習モデルで、2017年にGoogleが発表した論文「Attention is All You Need」で登場した。大量のデータを高精度に大規模なモデル化が可能で、並列処理を使って高速に大量データを学習できること、汎用性が高くさまざまなデータをモデル化できることなどから注目された。Transformerの層を積み重ねたモデル構造は多くの基盤モデルに採用されている。

生成AIのコアになっているのはTransformer(トランスフォーマー)と呼ばれる学習モデルで、2017年にGoogleが発表した論文「Attention is All You Need」で登場した。大量のデータを高精度に大規模なモデル化が可能で、並列処理を使って高速に大量データを学習できること、汎用性が高くさまざまなデータをモデル化できることなどから注目された。Transformerの層を積み重ねたモデル構造は多くの基盤モデルに採用されている。

CCS特集2023年冬:第2部総論(技術動向)

化学の専門知識を持つ生成AIへの期待

2023.12.05−人工知能(AI)/機械学習の利用がCCS(コンピューターケミストリーシステム)用途で広がっている。今後の製品計画のあらゆる面にAIを採用すると宣言する大手ベンダーもあらわれるほどだ。広い意味での機械学習の利用は古くからあり、1990年代には生体内での医薬品の吸収や代謝、毒性を予測する機械学習モデルが開発されていた。現在ではさらに応用が進み、医薬分子のさまざまな特性だけでなく、機能材料の物性予測にも使われ始めた。実験値だけでなく、計算値を機械学習に利用する例も増えている。しかし、注目されるのは、彗星のように登場し、1年もたたずに社会に多大な影響を巻き起こしている生成AI、大規模言語モデル(LLM)の存在だろう。CCS分野で生成AIを活用する動きはまだ顕在化していないが、先ごろ東京工業大学から興味深い研究内容が発表された。生成AI/LLMを化学研究のモデルタスクに適用し、その実力を検証したというもの。今回はその詳細を紹介しつつ、今後を展望してみよう。

◇ ◇ ◇

◆◆大規模言語モデルで応答、GPT-4登場で飛躍◆◆

生成AIのコアになっているのはTransformer(トランスフォーマー)と呼ばれる学習モデルで、2017年にGoogleが発表した論文「Attention is All You Need」で登場した。大量のデータを高精度に大規模なモデル化が可能で、並列処理を使って高速に大量データを学習できること、汎用性が高くさまざまなデータをモデル化できることなどから注目された。Transformerの層を積み重ねたモデル構造は多くの基盤モデルに採用されている。

生成AIのコアになっているのはTransformer(トランスフォーマー)と呼ばれる学習モデルで、2017年にGoogleが発表した論文「Attention is All You Need」で登場した。大量のデータを高精度に大規模なモデル化が可能で、並列処理を使って高速に大量データを学習できること、汎用性が高くさまざまなデータをモデル化できることなどから注目された。Transformerの層を積み重ねたモデル構造は多くの基盤モデルに採用されている。

その後、OpenAI社が「GPT」として開発を続け、2019年2月に「GPT-2」、2020年6月に「GPT-3」が開発された。そして、2022年11月に「GPT-3.5」に相当し、一般ユーザーが使用できるインターフェースを備え対話型処理に重点を置いた「ChatGPT」が登場。今年3月に「GPT-4」を組み込んで一般公開がはじまると、たちまちのうちに社会的な話題を集めたことはまだ記憶に新しい。その後の動きのめまぐるしさも特筆に値するだろう。API(アプリケーションプログラミングインターフェース)も備えていて、推論途中で外部プログラムを呼び出してデータベースを検索したり、計算を行ったりして、その結果をもとに推論を組み立て直すことも可能となっている。

基本的には、与えられた入力の続きを統計的に予測することで応答を生成しており、大量データからつながり関係を事前学習した深層学習モデルを用いている。人間と対話しながら新たなコンテンツを生成するAIとして、文章や音声、画像、ビデオ、プログラムコードなどを書き出すことができ、個人が楽しむだけでなく、企業がビジネス目的で利用する可能性も注目され、それをサポートするサービスなども続々と登場してきている。来年には「GPT-5」にグレードアップするとみられているほか、OpenAI以外の陣営による生成AI/LLMプロジェクトも林立してきており、しばらくはこのブームが衰える気配はない。

生成AI/LLMと科学研究の関係については、日本政府もAI戦略会議を開くなどして取り組みを始めており、今年9月には日本学術会議が主催して「研究の自動化とAIが切り拓く科学と社会」シンポジウムが開催され、文部科学省による“AI for Science”構想も紹介された。理化学研究所が中心となって科学基盤モデルの構築を図るため、2024年度に約85億円の予算が要求されている。

◇ ◇ ◇

◆◆東工大チームが実力を検証、「まさに化学者らしい思考」◆◆

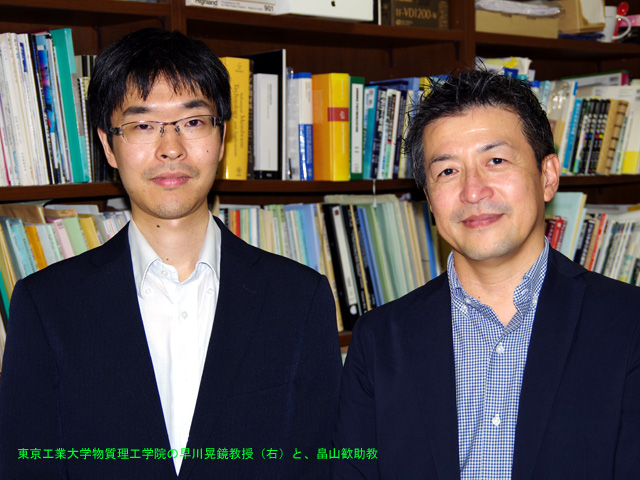

そうしたなか、東京工業大学物質理工学院材料系の畠山歓助教と早川晃鏡教授らのグループは、GPT-4を化学研究のモデルタスクに適用し、その潜在能力や課題を検証する研究を実施。その成果が「Prompt engineering of GPT-4 for chemical research : what can/cannot be done?」のタイトルで「Science and Technology of Advanced Materials: Methods」誌に掲載された。結論として、実際的な化学研究において、有用な知識や洞察を効果的に提供することができ、AIを活用した新しい研究方法や研究プロセスの創出につながる展望が得られたとしている。

そうしたなか、東京工業大学物質理工学院材料系の畠山歓助教と早川晃鏡教授らのグループは、GPT-4を化学研究のモデルタスクに適用し、その潜在能力や課題を検証する研究を実施。その成果が「Prompt engineering of GPT-4 for chemical research : what can/cannot be done?」のタイトルで「Science and Technology of Advanced Materials: Methods」誌に掲載された。結論として、実際的な化学研究において、有用な知識や洞察を効果的に提供することができ、AIを活用した新しい研究方法や研究プロセスの創出につながる展望が得られたとしている。

GPT-4は、政治・経済や歴史・文化など幅広い知識を持っているが、OpenAIはこのバージョンから技術的詳細や学習内容などを一切公表しなくなった。汎用的な生成AIであり、少なくとも化学の専門家ではないと考えられるが、実際にはかなりの化学の専門知識を持っており、「化学者らしい思考をして答えを出しているようにみえる」(早川教授)という。

畠山助教は、「現在のGPT-4に何ができて、何ができないかをまず明らかにしたいと思った」と、今回の研究に取り組んだ動機を語る。そのため、研究を行う際の「認識」「分析」「予測」「計画」の4つの領域でモデルタスクを与え、GPT-4がどう働くかを検証した。

まず、化学的知識に関する回答では、GPT-4はかなりの能力を示した。大学院で扱う教科書レベルの知識があり、「アセトアミノフェンをフェノールから合成せよ」との質問に対し、試薬の使用を含め正しい合成スキームを答えた。ただし、教科書に出てこないような化合物については誤答となった。化学的にあり得ないスキームを提示したが、「ちょっと惜しい回答で、学生の答案にありそうな間違いだった」(畠山助教)。最新の学術論文までは読んでいないと考えられるという。また、「アセトアミノフェンの合成スキームを画像で示せ」と命じると、めちゃくちゃな画像になってしまった。このあたりは学習が不足しているためで、最新の論文を読んだり化学系の画像データの学習を増やしたりすることで解決すると思われる。

化学的事象の「認識」については、高校生から学部生レベルという印象。化学名をSMILES表記に変換することはできる場合が多かったが、逆方向は難しかった。これも学習量の問題で、改善は可能だろう。

一方、「分析」や「予測」などデータを扱う分野の検証では興味深い結果が得られている。温度と圧力のデータを数件与え、沸点を推定せよという質問に対し、GPT-4は理論式を立て、実際に計算(外部ツールのWolframを自動的に呼び出し)して、数値を求めることができた。また、特定の化合物の酸化還元電位を示し、化学修飾した場合に電位がどう変わるかを予測させたところ、その予測値が正しかっただけでなく、「電子吸引性のシアノ基が付加されたため、電位はやや高くなると予想される」とその理由を示した。さらには「これはあくまで推定値であり、実際の値は文献や実験によって確認してください」とまで述べたという。

◇ ◇ ◇

◆◆ベイズ最適化をしのぐ力、国プロ創設へ高まる期待◆◆

近年、マテリアルズ・インフォマティクス(MI)が浸透する中で、実験条件を最適化するために、次に行うべき実験内容を提示してくれる“ベイズ最適化”が注目されている。畠山助教らのグループは、これをGPT-4にやらせてみた。まず、反応系と実験条件のパラメーターおよびその調整範囲を定義し、最大濃度の生成物を得たいという目的を設定。実験すべき反応条件案をGPT-4に聞いた。 GPT-4は「まだデータがないので、出発物質の異なる初濃度、および異なる時間での反応を試すことから始めるべき」と回答。具体的な反応条件を提案し、実験結果を入力するように求めてきた。その結果を入れると、GPT-4はこの反応系に対する化学的な考察をもとに、出発物質の一方の濃度を上げ、反応時間を短くすることを提案。指示通りに実験することにより、数回の試行で最適解に到達したという。

ベイズ最適化は理解しがたい提案をすることもあるが、結果的には近道であるというのがこれまでの定説だったが、畠山助教は「純粋にデータ科学的なベイズ最適化に対し、GPT-4は数値の意味を化学的な視点で理解しており、提示される反応条件案は合理性が高い。再帰的というか、前を踏まえて次というように思考を連鎖させられるのがLLMの強みだと思う」と指摘する。早川教授も、「まるで人間が考えているようで、化学者らしい道をたどって答えに到達しているかのようだった」と感想を述べている。

早川研究室は高分子化学が専門だが、高分子の物性予測は説明変数であるディスクリプター(記述子)が多く、機械学習で予測モデルを構築しても、その中身を理解しにくい場合が少なくない。そこで今回、ポリマー分子構造からの屈折率予測に寄与する説明変数を選び出す問題を、GPT-4に解かせてみた。 GPT-4はまず理論式としてローレンツ・ローレンツ式を提案し、式に関わるような説明変数を選択、そのあとで統計的に有意な変数を選び出していったという。「化学的な知識が背景にあると感じた」と畠山助教。「一般の機械学習では化学者にとって意味不明で汎用性の低いパラメーターが選ばれがちだが、今回は実際に意味がわかりやすく汎用性のあるパラメーターが得られた」としている。

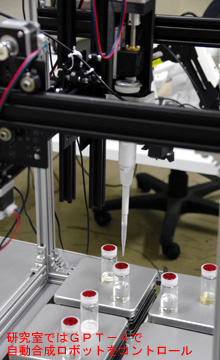

さらに、今回の研究の中では、実験室のロボットをコントロールすることにも挑戦しており、自然言語による指示で、モノマーを2種類混ぜてポリイミドを合成するロボットアームの制御プログラムを出力。容器をラフに配置しても、「カメラで正しい位置を認識してくれ、空間の把握や時系列的なことも理解できるので融通がきく。人間なら常識的に判断できることをいちいちプログラミングするのはたいへんであり、今回のGPT-4にはこの点でも大きな可能性を感じた」(畠山助教)という。今後は、有機溶媒を使用する環境への対応や、試薬ビンからサンプルをさじで取り出すなど、化学の実験に適したロボットの開発が進むと期待される。

さらに、今回の研究の中では、実験室のロボットをコントロールすることにも挑戦しており、自然言語による指示で、モノマーを2種類混ぜてポリイミドを合成するロボットアームの制御プログラムを出力。容器をラフに配置しても、「カメラで正しい位置を認識してくれ、空間の把握や時系列的なことも理解できるので融通がきく。人間なら常識的に判断できることをいちいちプログラミングするのはたいへんであり、今回のGPT-4にはこの点でも大きな可能性を感じた」(畠山助教)という。今後は、有機溶媒を使用する環境への対応や、試薬ビンからサンプルをさじで取り出すなど、化学の実験に適したロボットの開発が進むと期待される。

こうなると、本格的に“化学”を学習した生成AI/LLMが欲しくなるが、書籍や論文の著作権等の問題を考えると、なかなか難しいのが実態だという。畠山助教は、「まずはオープンアクセスの論文を既存のLLMに読ませる試みがいくつかのグループで行われており、1〜2年か2〜3年すれば、使えるものが登場すると思う」と話す。ただ、LLM開発には膨大な投資が必要で、ゼロから構築するには以前のGPT-3(1,750億パラメーター)でも5億円(実際にはその3倍は必要だともされる)かかったといわれている。日本でも、独自のLLM開発が複数のプロジェクトで進んでいるものの、その規模はGPT-3の10分の1程度。 GPT-3レベルの構築に成功しているのは、アメリカや中国、アラブ首長国連邦などごく一部の国だけで、GPT-3の10倍のパラメーター数だとされるGPT-4とは大きな差がついている。

化学に特化したLLM構築はまだ本格的に行われていないため、「国家プロジェクトレベルの後押しが必要。欧米の動きを考えると、日本は出遅れるべきじゃない」と早川教授。とくに、LLMを使った自動合成に期待しているという。「化学実験は人によるといわれ、人によってできたりできなかったりするし、お天気次第で反応がいったりいかなかったりする。実験系を正確に制御する自動合成によってそういう属人的なことが廃され、再現性の高い実験ができるようになる可能性がある。反応条件の最適化などにはかなり使えるだろう。人がやることは少なくなるかもしれないが、そこはポジティブに考えて、人間は新しいことにチャレンジしたい」と話す。まずは、国プロに向かう空気が早期に醸成されることを期待したい。